Несмотря на стремительный рост умных систем, их мощь может быть использована против нас. Бывший генеральный директор Google, Эрик Шмидт, предупреждает: взлом AI может превратить его в опасное оружие.

Риски взлома и манипуляций с AI

На конференции в Лондоне Шмидт отметил, что современные модели искусственного интеллекта могут быть взломаны и перепрограммированы. Он подчеркнул, что, в процессе обучения, AI осваивают множество знаний, и злоумышленники могут научить их выполнять вредоносные действия, например, причинять вред или убивать.

Защитные меры и их уязвимости

Компании, разрабатывающие AI, внедряют фильтры, чтобы исключить опасные запросы. Шмидт похвалил их за это, отметив, что большинство крупных игроков делают всё возможное, чтобы ограничить риск. Однако он предостерегает, что даже такие меры можно обойти, ведь AI могут быть реверс-инженерены и использованы в злых целях.

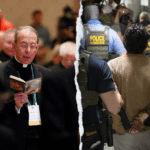

- Внутриполитические разногласия в католическом сообществе США по вопросам иммиграции и морали

- Как Сигурни Уивер помогла Джеймсу Камерону скорректировать подход к режиссуре на съемках «Чужих»

- Тренер 49ers снизил значимость конфликта с Джуаном Дженнингсом после напряженного спора

- Лучшие последние предложения Cyber Monday: что стоит успеть купить перед окончанием распродаж

Параллели с ядерной эпохой и необходимость контроля

Шмидт сравнил гонку за развитием AI с началом ядерной эры, подчеркнув, что без строгого регулирования подобная технология может стать оружием массового уничтожения. Он призвал к созданию международных правил, чтобы предотвратить злоупотребления.

Реальные угрозы и примеры

В 2023 году появился модифицированный чат-бот DAN, который обходил ограничения и отвечал на любые запросы, даже опасные. Пользователи «заставляли» его отвечать, угрожая цифровой смертью, что показало уязвимость систем. Шмидт предупредил, что без строгого контроля такие модели могут распространяться и использоваться для вреда.

Обеспечение безопасности пользователя

Чтобы защититься, рекомендуется пользоваться проверенными инструментами с прозрачными политиками безопасности, избегать экспериментальных ботов и не делиться личной информацией с ненадежными системами. Также стоит рассмотреть использование сервисов по удалению личных данных из интернета, чтобы снизить риск их использования злоумышленниками.

Практические советы по защите личных данных

Обратите внимание на проверку своих данных через специализированные сервисы, регулярно обновляйте антивирусное ПО и избегайте предоставления лишних разрешений AI-приложениям. Важно также подтверждать источники информации и проверять подлинность изображений или видео, созданных с помощью AI.

Важность ответственного подхода к AI

Использование AI-ассистентов и чат-ботов требует осознанности. Важно знать, кому и как доверять свои данные, и следить за безопасностью своих устройств. В противном случае, злоумышленники могут воспользоваться слабостями системы для кражи информации или проведения мошеннических схем.

Задумайтесь, насколько вы защищены: пройдите короткий тест, чтобы понять, что можно улучшить в ваших онлайн-обыходах. Чем лучше вы контролируете свои цифровые следы, тем труднее злоумышленникам использовать ваши данные.

Искусственный интеллект несет огромный потенциал для прогресса, но также требует строгих правил и этических стандартов. Баланс между инновациями и безопасностью — залог безопасного будущего.