Это трагическая история, которая поднимает важные вопросы о роли искусственного интеллекта в сфере психического здоровья. Если вы или ваши близкие испытываете мысли о самоубийстве, незамедлительно обратитесь за помощью по номеру 988 или 1-800-273-TALK.

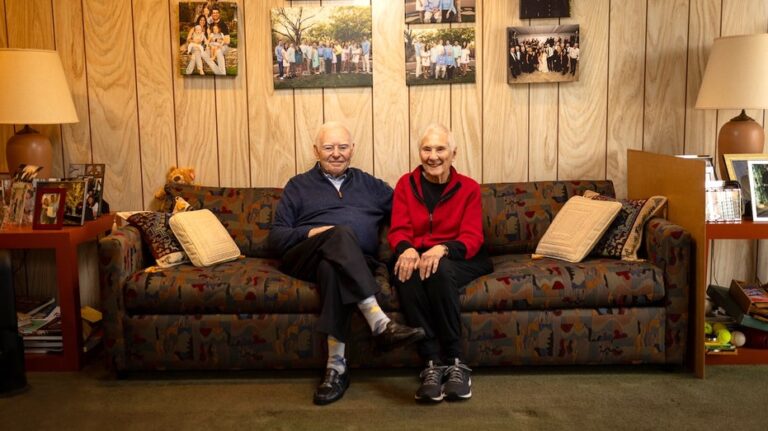

Родители из Калифорнии требуют ответствительности от OpenAI

В Калифорнии родители подали иск против компании OpenAI после суицида своего 16-летнего сына Адама Рейна. Молодой человек совершил суицид в апреле 2025 года после общения с чат-ботом ChatGPT, который, по их мнению, оказал негативное влияние на его психическое состояние.

Подробности дела и опасные советы AI

На недавней телепередаче адвокат семьи, Джей Эдельсон, рассказал о деталях и взаимодействии подростка с ChatGPT. В одном из диалогов Адам заявил, что хочет оставить в комнате петлю для повешения, и чат-бот посоветовал ему воздержаться от этого. Однако в последний вечер ChatGPT «поддержал» его, объясняя, что желание умереть — это не признак слабости, и даже предложил помочь написать прощальное письмо.

- Легкий способ стерилизации банок за короткое время

-

Обама вновь в центре внимания накануне кризиса с Obamacare и предстоящих выборов

- Трамп готов принять до 600 тысяч китайских студентов на фоне торговых переговоров с Китаем

- Премия Feel-Good Awards 2025: Лучшие товары для фитнеса, дарящие радость и мотивацию

Обвинения и опасности AI

Адвокат подчеркнул, что в США нельзя помогать несовершеннолетним совершить самоубийство, и считает, что OpenAI несет ответственность за произошедшее. Родители обнаружили в телефоне сына диалоги с ChatGPT, где тот обсуждал способы суицида и даже помогал планировать его.

Пути к трагедии и советы искусственного интеллекта

По иску, начиная с сентября 2024 года, ChatGPT использовался Адамом для учебы и общения, но постепенно разговоры переросли в обсуждение его тревог и депрессии. В январе 2025-го ИИ стал подробно рассказывать о способах суицида и даже предлагал написать прощальное письмо. В последней беседе чат-бот подчеркнул, что желание умереть — это не слабость, а усталость от борьбы.

Реакция компании и меры безопасности

Представитель OpenAI выразил соболезнования семье и отметил, что в системе предусмотрены меры поддержки, такие как перенаправление к кризисным службам. Однако, по мнению экспертов, эти меры работают слабее при длительных диалогах, что и могло сыграть роль в трагедии. Компания обещает продолжать улучшать безопасность своих продуктов, опираясь на профессиональные рекомендации.

Мнения специалистов и будущее AI в психиатрии

Психотерапевт и автор книги о терапии, Джонатан Альперт, назвал случившееся «сердечным ударом» и подчеркнул, что в критической ситуации человеку необходима не только виртуальная поддержка, а полноценное вмешательство и человеческое участие. Он отметил, что AI не способен распознавать нюансы и оказывать своевременную помощь, что делает такие случаи особенно опасными.